Googleに爆速でインデックスさせる方法!申請から登録までの時間を比較

2020.10.19

webに記事やコンテンツをアップした際、googleではロボットがクロール(巡回)し、アップした記事を見つけ、検索エンジンに自分のサイトが登録されます。特に速報性の高いコンテンツの場合、早くインデックスされた方がそれだけユーザーに目に触れるチャンスが広がります。今回は検索エンジンに早くインデックス登録されるためにはどの方法が良いか検証してみました。

そもそもインデックスとは?

インデックス(index)とは、直訳すると索引といった意味で、索引は、項目を素早く参照できるよう、見出しを特定の条件で並べ、各項目の所在をまとめたものになります。

seoの世界では、検索エンジンのクローラーが収集したデータ(コンテンツ)を検索エンジンのデータベースに登録されることを指します。検索エンジンがコンテンツをデータベースに登録しないとweb上でそのコンテンツを見ることがかなり難しくなります。

インデックスについては下記の記事でも解説しています。

Googleが推奨する申請方法は「URL検査」と「XMLサイトマップ」の2択

Googleでは、インデックスの申請方法として下記の2種類を推奨しています。

- URL検査:「個別のURLごと」にインデックスを申請する方法

- XMLサイトマップ:「複数のURL情報」をまとめて伝え、インデックスを促す方法

特に、コンテンツ数の多いサイトやPCとモバイルでURLが異なるサイトは、XMLサイトマップをSearch Consoleに登録しておきましょう。

なぜなら、ページURLと更新日がリスト化されたXMLサイトマップは、GoogleのクローラーにとってWebサイトの情報を把握するための重要な手掛かりになるからです。

XMLサイトマップを定期的に更新することで常に最新の情報がクローラーに伝わり、クローラビリティが向上してインデックス漏れが防げます。

なお、URL検査やXMLサイトマップの登録方法については、下記の記事にて画像つきで解説しております。

インデックスの登録時間を比較してみた

インデックスされやすいサイトの特徴として、更新性が高い、被リンクを多く獲得している、ツールを使ってインデックス登録を促したサイトが挙げられます。

今回は弊社が運用しているサイトや弊社サイト(https://pecopla.net/)を使って、以下の3パターンで記事をアップし、どのくらいでインデックスされるか検証してみました。なお運用しているサイトは1か月に複数記事をアップしているサイトで、特定のキーワードで上位化をしているサイトになります。

- 何もしない:クローラーがリンクを辿ってコンテンツを発見し、インデックスする

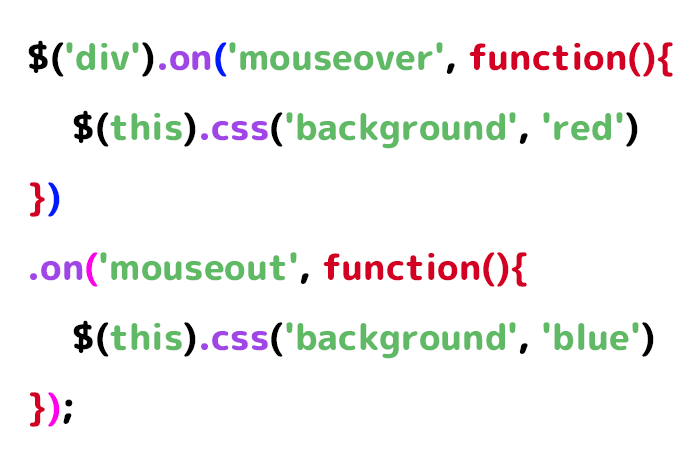

- PubSubHubbub/WebSub:記事を早くインデックス登録するためにプッシュ送信するプラグイン

- サーチコンソールのURL検査(旧Fetch as Google):Google推奨のインデックス登録方法

| インデックスの登録時間を比較 |

| 記事URL |

インデックス登録を促した方法 |

インデックス登録までの時間 |

| http://text-correction.info/column/excellent-site-determine |

何もなし |

4日以上 |

| https://pecopla.net/web-column/what-is-amp |

URL検査(旧Fetch as Google) |

1時間 |

| https://pecopla.net/seo-column/inflow-rate |

PubSubHubbub/WebSub |

24時間 |

| https://pecopla.net/seo-column/how-to-use-canonical |

PubSubHubbub/WebSub |

24時間 |

新規ページを頻繁に追加する上記を見てみるとサーチコンソールのURL検査(旧Fetch as Google)が一番早いという結果になりました。

seo業界では爆速にインデックスすると評判のPubSubHubbub/WebSubは、弊社のサイトでは24時間という結果でした。

なお、googleのジョン・ミューラー氏は、PubSubHubbub/WebSubのサポートをしていると発言していましたが、

同じgoogleのゲイリー・イリェーシュ氏は2017年8月に開催されたGoogle Dance Tokyo 2017で以下のように発言していますので真相は不明です。

今でもメンテナンスされているかどうかわからない。サポートは続けているはずだけれど、きちんと機能しているかどうかは僕には確証がもてない。

インデックス登録を早める方法

URL検査から申請し、なおかつ登録したXMLサイトマップを定期的に更新しているからといって、必ずしも短時間でインデックスされる訳ではありません。

わずか5分ほどでインデックスされるページもあれば、何日も待たされるページもあるのです。

ここで注目したいのがクローラビリティ!インデックス登録を早めるには、まずGoogleのクローラーに巡回してもらえる頻度を向上させなければなりません。

この段落では、より早くGoogleにインデックス登録されるよう日頃のクローラビリティを高める方法について解説します。

クローラーについては下記の記事でも解説しています。

新規ページを頻繁に追加する

結論から言うと、クローラビリティを高める最も効果的な方法は、「新規ページを頻繁かつ継続的に追加する」方法です。

たとえ総コンテンツ数が少ないサイトでも頻繁に新規ページを追加することで、更新頻度の低い大規模サイトよりもクロールされやすくなります。

- 全300コンテンツのサイトに、毎日1ページを追加する:クローラビリティが向上する

- 全500コンテンツのサイトに、半年に1ページを追加する:クローラビリティが低下する

つまり、Googleのクローラーは更新頻度の高いWebサイトほど、こまめに巡回する性質を持っているのです。

ただし、ユーザーにとって有益なコンテンツでなければ意味がありません。

無意味なページの量産は、パンダアルゴリズムによってスパムと判定されてしまいます。

スパムについては下記の記事でも解説しています。

SNSを含む外部リンクを増やす

ページによっては、わざわざ申請しなくてもインデックスされるケースがあります。

その理由は、Googleのクローラーが外部リンクを辿ってネット上を巡回し、新規コンテンツを発見してインデックスしているからです。

例題として、クローラーの思考プロセスを見てみましょう。

- 外部リンクが多いページを発見

- このページには重要な情報が含まれている可能性が高い

- 積極的にインデックスすべきページだと判断

つまり、外部リンクを増やすほどクローラーを呼び込む導入経路も増え、さらに検索順位を上げるSEO効果も期待できるのです。

クローラビリティの向上に役立つ外部リンクには各種SNSも含まれており、特にFacebookは通常のウェブページと同じくインデックス処理の対象に含まれています。

ただし、SNSには検索順位が不正に操作されないように「nofollow属性」が自動的に付与されるため、検索順位を上げる直接的なSEO効果はありません。

▼関連記事

ping送信

記事をまとめて収集しているpingサーバーにサイトの更新情報を伝える「ping送信」も、Googleにインデックスを促す効果的な方法です。

Googleのクローラーは日々リンクを辿ってネット上を巡回していますので、pingサーバー経由で発見されたコンテンツもインデックスの対象となります。

インデックスに役立つping送信先リストやSEO効果の詳細については、下記の記事を参照して下さい。

クローラビリティを高めるサイト構造の最適化

短時間でインデックスされるWebサイトには、「Googleのクローラーにとって巡回しやすい内部構造」が備わっています。

申請してからインデックス登録されるまで時間がかかるという場合は、サイト構造や内部リンクを最適化してみましょう。

階層構造(ディレクトリ構造)をシンプルにする

クローラーは、サイト構造がシンプルであるほど全体を把握しやすくなります。

あまりにも深い階層にインデックスして欲しいページがあった場合、クローラーは素早く発見できないのです。

階層構造が浅くシンプルなほどクローラーの巡回頻度が高まり、結果的にインデックス漏れの防止にも繋がります。

ディレクトリ構造については下記の記事でも解説しています。

パンくずリストなどのサイトナビゲーションを設置する

内部リンクは効果的なSEO対策である反面、整頓されていないとクロールの妨げになってしまいます。

Googleのクローラーを最短距離で該当のページへ誘導するために、下記のようなサイトナビゲーションを設定しておきましょう。

▼サイトナビゲーションの種類

なお、パンくずリストとページネーションの詳細については下記の記事を参照して下さい。

ページの表示速度を早くする

Googleから低品質コンテンツだと判断されたページはインデックスされない可能性が高く、表示速度の遅さも判断基準に含まれています。

Googleは2021年からUX指標Core Web Vitals(コアウェブバイタル)を検索ランキングの評価シグナルに追加すると発表していますので、ページの読み込み速度の速さはクローラーの巡回率に直結すると考えて良いでしょう。

インデックスされないパターンとは

検索エンジンでは、WEB上を巡回するクローラーロボットが、どのような画像が記載されているのか、他のサイトとの違い、どのようなコードが記載されているのかなど様々な情報を集めます。その情報を基に検索エンジンではインデックスするか判断していきます。そのため、インデックスされない可能性もあります。

具体的にどのような場合においてインデックスされないのか見ていきます。今回はgoogleを例にしていきます。

なお、googleでインデックス登録されているかどうかは検索窓からsite:の後に対象URLを入力することで確認できます。

タグにインデックスしない記載がある

メタタグの中にnoindexが記載されていると、インデックス拒否の意味になりますので、インデックスされません。ミラーページなど全く同じページを複数公開する場合はこのタグを使いますが、通常のコンテンツや記事をアップする場合は使う必要がない属性です。

<meta name="robots" content="noindex">

noindexについては下記の記事でも解説しています。

robots.txtの設定

robots.txtは検索エンジンにクロールしたくないディレクトリやファイルを指定することで、クロールしなくなります。例えば以下のような設定ですと、全てのクローラはトップディレクトリから巡回するなという意味になりますので、robots.txtでクロールしたくないディレクトリやファイルを指定している場合は、設定に誤りがないか確認してみてください。

User-agent: *

Disallow: /

robots.txtについては下記の記事でも解説しています。

Googleからペナルティを受けている

googleからペナルティを受けていた場合、インデックスが削除される可能性があります。ペナルティーを受けているかは、Google Search Consoleで確認できますので、導入していない場合は、登録してみることをお勧めします。また中古ドメインを取得していて、そのドメインが過去にガイドライン違反があった場合も同様です。

コピーコンテンツなど質が低い

コピーコンテンツなどgoogleが質が低いと判断したコンテンツは、登録されない可能性があります。その他、ページがエラーになっているものや、サイトマップがうまく認識されていない場合もインデックス登録されない可能性があります。

▼関連記事

まとめ

いかがでしたか?あくまでも今回のケースですが、予想に反してURL検査(旧Fetch as Google)が一番早くインデックスされるという結果になりました。

URL検査はGoogle Search Consoleの1機能となりますので、Google Search Consoleの登録が済んでいない方は登録し、URL検査を使ってみてください。

関連