noindex タグを使うべきページの選定基準とは?SEO効果・設定方法などを解説!

2023.07.20

noindexタグは非常に効果の高いSEO対策です。その反面、誤った方法で設定するとサイト全体の評価が低下するリスクを併せ持っています。そこで本記事では、noindexの役割・類似タグとの違い・対象ページを選ぶ基準・設定方法などをまとめてみました。

noindexタグとは?

noindexタグとは、特定のコンテンツがインデックスされないよう、検索エンジンに指令を出すためのmeteタグのことです。

インデックスされたかったページは、検索結果に表示されません。

言い換えれば、noindexタグとはWebサイトのSEO評価を低下させるコピーコンテンツなど、検索結果に表示させたくないページがある時に用いるタグなのです。

ここからは、noindexタグへの理解が深まるよう、下記の3項目に分けて解説していきます。

- noindexタグの仕組み

- クロールの巡回は阻止できない

- noindexとnofollowの違い

- noindexとtxtの違い

関連記事

noindexタグの仕組み

まずは、コンテンツが検索結果に表示されるまでのプロセスについて、もう一度おさらいしておきましょう。

検索エンジンは第1段階のクロールでコンテンツの存在を認識し、第2段階のインデックスでページの情報をデータベースに登録し、第3段階のランキングによって決定した順位で検索結果に表示します。

つまり、noindexタグは文字通り第2段階のインデックスをブロックし、検索結果に表示させない役割を担っているのです。

クロールの巡回は阻止できない

コンテンツが検索結果に表示される一連の流れの中で、noindexタグが作用するタイミングは、第2段階にあたるインデックスの直前です。

したがって、noindexタグでインデックスの前段階にあたる「クロールの巡回」を阻止することはできません。

つまり、noindexタグを設定したコンテンツは検索結果で非表示にはなるものの、存在自体は検索エンジンに認知されている状態なのです。

特筆すべきは、検索エンジンは存在を認知したページに対してクロールを繰り返すという点でしょう。

たとえnoindexタグによってインデックスされていなくても、クロールされる度にサイト内部・外部を問わずリンク先が辿られてしまいます。

コンテンツに低品質の外部リンクを設定している場合は、自サイトまでSEO評価が低下しないよう、noindexと一緒にnofollowを設定し、外部リンク先が辿れないように防御しておきましょう。

関連記事

noindexとnofollowの違い

noindexタグと混同されがちなのが、「nofollowタグ」です。

ただし、両者はスペルが似ているというだけで、その役割は全く異なります。

▼役割の違い

- noindexタグ:検索結果に表示さないために、インデックスをブロックする

- nofollowタグ:リンクジュースの悪影響を防ぐために、外部リンク先へのクロールをブロックする

関連記事

noindexとrobots.txtの違い

一方、noindexと似たような働きをするのが「robots.txt」です。

まずは「noindexタグ」と「robots.txtタグ」の共通点について理解しておきましょう。

両者には「検索エンジンの働きの一部を制御する」という共通点がありますが、その効果には下記のような違いがあります。

▼共通点

- 検索エンジンの働きの一部を制御する

- 内容を評価されたくないコンテンツに対して使用する

ただし、両者の効果には下記のような違いがあります。

▼効果の違い

- noindex:クロールによって存在は認知されるが、インデックスはされない

- txt:クロール自体がブロックされ、存在自体が認知されない

robots.txtとは、指定したディレクトリやURLがクロールされないよう、検索エンジンに指示を出すためのテキストファイルです。

クロールが禁止された検索エンジンはコンテンツの存在自体が認知できないため、noindexのようにムダなクローリングが繰り返されることはありません。

つまり、robots.txtを使用する目的は、サイト内のクローラー巡回効率を向上させるために、不必要なページの存在を検索エンジンに気づかせないようにすることです。

クローラーの巡回効率が向上するほど、より重要なページが素早く検索エンジンに認知され、公開してから検索結果に表示されるまでのタイムラグが短縮されます。

関連記事

noindexタグのSEO効果とは?

「noindexタグにSEO効果はあるの?」という質問に対する答えは「Yes」です。

具体的には、直接または間接的に下記のようなSEO効果が期待できます。

▼noindexタグのSEO効果

- 低品質コンテンツが非表示になるので、マイナス評価を受けなくて済む

- 高品質コンテンツだけがインデックスされるので、サイト全体のSEO評価が上がる

- 不必要なページが検索結果から除外される分、ユーザビリティが改善する

noindex タグを使うべきページの選定基準

noindexタグを設定すべきURLには一定の基準があり、下記のいずれかに該当します。

- SEO評価を下げるページ

- ユーザーが検索ニーズを感じないページ(検索流入が「0」のページ)

- 検索結果に表示させる必要はないが、削除はできないページ

3番に当てはまるのは、「検索流入が不要なページ」や「社外秘のページ」などです。

一方、下記の項目を「満たしているページ」は検索結果に表示させておく必要があるため、noindexタグを使うべきではありません。

- ユーザーにとって、検索してでも知りたい有益な情報が書かれている

- サイト運営者にとって、一般公開しても差し障りがない

noindexを設定するべき7つのケース

ここからは、noindexを設定するべき具体的な事例について解説していきます。

▼noindexを設定するべきページ

- 重複コンテンツ

- 低品質コンテンツ

- エラーページ

- サンクスページ

- HTMLサイトマップページ

- WordPressなどの管理画面

- 作成中のテストページ

重複コンテンツ

重複コンテンツ(コピーコンテンツ)は、サイト内外を問わずSEO評価を下げる要因です。

▼重複コンテンツの一例

- 内容が似ている複数のページを、自サイトから公開している

- 他サイトの記事を無断でコピペしている

サイト内の重複コンテンツは、オリジナルコンテンツに作り直すのが基本的な対処法ですが、対応には手間と時間がかかるうえ、色違いの商品ページのように残しておくべき重複コンテンツもあります。

だからこそ、サイト内で重複コンテンツを見つけた場合は、まずはnoindexタグを設定してインデックをブロックしておくのが先決なのです。

関連記事

低品質コンテンツ

低品質コンテンツも、noindexタグを設定すべき代表的なケースです。

▼低品質コンテンツの一例

- 情報量が少なすぎる

- タイトルのみなど、未完成の状態

- 誤った情報が発信されている

- 最新情報に更新されていない

上記のように、ユーザーの満足度を満たせていない、あるいはE-E-A-Tを順守していない低品質コンテンツは、検索結果に表示させない方がSEOにとって有利です。

関連記事

エラーページ

404などのエラーページは、「検索結果に表示させる必要はないが、削除はできないページ」の典型事例です。

エラーページに情報コンテンツとしての価値はありません。

わざわざエラーページを検索するユーザーは居ないので、検索結果から除外しても支障はないでしょう。

だからと言って、削除してしまうとユーザビリティが低下するため、Webサイト内には残しておく必要があります。

その点、エラーページにnoindexタグを設定しておけば、サイト内に残したまま検索結果から除外することができるのです。

関連記事

サンクスページ

「申し込みありがとうございました!」的な画面が表示されるサンクスページも、noindexタグを設定すべきケースです。

そもそも、インデックスされているということは、検索結果からのアクセスを許可しているのと同義です。

インデックスされているサンクスページをデータ計測しようとすると、「実際に実行したユーザー」に「検索流入」が加算され、正確な結果が出せません。

HTMLサイトマップページ

複数のコンテンツをまとめて一覧表にしたHTMLサイトマップは、ユーザーにとっても便利な存在です。

とは言え、あくまでリンク集ですから検索結果からの大量流入は見込めません。

むしろ、コンテンツごとの短い解説文が元ページの内容と似すぎていると、重複コンテンツと見なさるリスクもあるのです。

noindexタグでインデックスを阻止しつつ、ユーザーの利便性が損なわれないよう、サイト内には残しておくべきでしょう。

関連記事

WordPressなどの管理画面

WordPressなどの管理画面は、一般公開せずに「社外秘あつかい」にしておくのが基本です。

たとえパスワードなどで不正アクセスを予防していたとしても、リスクは「0」ではありません。

作成中のテストページ

テストページは、完成するまでnoindexタグを設定して部外者が閲覧できないようにしておきましょう。

作業中に一般公開すると、低品質コンテンツと判定される可能性があります。

noindexタグを設定する2つの方法

noindexタグを設定する主な方法として、下記の2種類が挙げられます。

▼noindexタグの設定方法

- WordPressで設定する方法

- htmlに記述する方法

2番では、「Googleだけにnoindexを設定する方法」と「nofollowを同時に設定する方法」も併せて解説します。

WordPressで設定する方法

WordPressの場合は、「All in One SEO Pack」というプラグインを使うと、簡単かつページごとにnoindexを設定することができます。

▼ページごとに設定する手順

- 投稿ページまたは固定ページの「編集画面」を開く

- AIOSEO設定にある「Advanced」をクリックする

- ロボット設定の「デフォルト設定を使用」を無効化する

- 「インデックスなし」にチェックマークを入れる

- ページを更新する

なお、下記の方法を選択するとサイト全体がインデックスされなくなってしまうので、注意が必要です。

▼サイト全体に対してインデックスを阻止する方法

- ロボット設定の「デフォルト設定を使用」を有効にする(上記の3番)

- 表示設定の「検索エンジンがサイトをインデックスしないようにする」にチェックを入れる

htmlに記述する方法

noindexタグだけを設定する場合は、htmlファイルの<head>タグと</head>タグの間に、下記のコードを記述します。

<head>

<meta name="robots" content="noindex"/>

</head>

Googleだけにnoindexを設定する方法

対象をGoogleだけに限定するなど、特定の検索エンジンに対してnoindexタグを単独で設定する際のコードは、下記の通りです。

<head>

<meta name="googlebot" content="noindex"/>

</head>

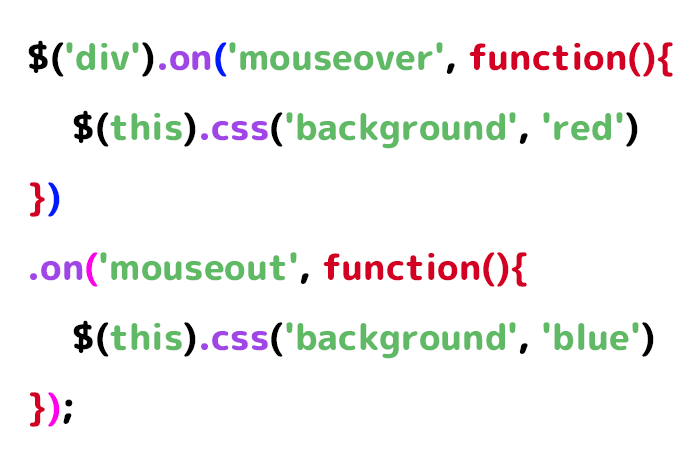

noindexとnofollowを同時に設定する方法

htmlファイルのhead内に挿入するコードは2種類あり、どちらも効力は同じです。

▼記述例①

<head>

<meta name="robots" content="noindex,nofollow"/>

</head>

▼記述例②

<head>

<meta name=”robots” content=”noindex”/>

<meta name=”robots” content=”nofollow”/>

</head>

noindexの確認方法

noindexタグを設定したら、成功しているかどうか確認しておきましょう。

▼確認方法

- Googleサーチコンソールで確認する方法

- Chromeの拡張機能で確認する方法

Googleサーチコンソールで確認する方法

Google Search Consoleで確認する手順は、下記の通りです。

▼確認する手順

- カバレッジを開く

- 「除外」のチェックボックスに、チェックを入れる

- ページ下部の「詳細」から、「noindexタグによって除外されました」を選択

- noindexが設定されているページのURLが一覧表示される

- リストに該当ページがあれば成功

Chromeの拡張機能で確認する方法

もう1つは、Google Chromeの「NoFollow」という拡張機能を活用する方法です。

▼確認する手順

- 拡張機能「NoFollow」をインストールする

- ブラウザ画面の右下に、「noindexの設定状態」が表示される

こちらの拡張機能は、名称通りnofollowの設定状況も確認することができます。

noindexタグの注意点

最後に、noindexに関する3つの注意点についてご紹介します。

▼注意点

- noindexの乱用はNG

- 反映されるまで時間がかかる

- 不要なnoindexは解除する

noindexの乱用はNG

noindexタグを設定したページが多くなるほど検索エンジンからの流入が減り、サイト全体のSEO評価が下落します。

中でも、失敗例としてありがちなのが「アクセスが少ない=低品質コンテンツ」と誤解して、すべての該当ページにnoindexタグを設定するケースです。

例えば、「この商品は売り切れです」「再入荷の時期は未定です」などのアナウンスページは、限定アイテムや売れ筋商品を探している人にとって、少なからず役に立ちます。

つまり、たとえアクセス数が芳しくなくても、ユーザーにとって有益なコンテンツであれば、むしろ検索結果に残すべなのです。

どのページに設定すべきか迷ったら、「noindex タグを使うべきページの選定基準」の章で解説した見極めポイントを参考にしてください。

反映されるまで時間がかかる

noindexタグは、即日反映される訳ではありません。

そもそも、設定後にページがクロールされなければ、検索エンジンはnoindexタグを検知できないのです。

クロール頻度はサイトによって差が大きいため一概には言えませんが、数日~1ヵ月の待機期間を想定しておいた方が良いでしょう。

不要になったnoindexは解除する

リライト中やテスト期間などに設定したnoindexは、公開前に解除しておきましょう。

noindexタグを設定したまま公開すると、いつまで経っても検索結果に表示されません。

まとめ

noindexはSEO対策の基本であると同時に、さほど難易度は高くないため初心者でも導入しやすいのが特徴です。

ただし、適切に設定しないと意図せず検索結果からコンテンツが除外され、アクセス減少によりサイト全体のSEO評価が低下してしまいます。

noindexを設定する際は、「どのページに使うべきか」をよく吟味してから実装しましょう。

関連